تصویر کلی: این روزها نمیتوانید پنج دقیقه بدون شنیدن درباره هوش مصنوعی سپری کنید. اما آیا تا به حال فکر کردهاید که چگونه به اینجا رسیدیم؟ بخش بزرگی از این پیشرفت مدیون یک شبکه عصبی پیشگامانه از سال ۲۰۱۲ به نام AlexNet است. اگرچه این شبکه در ابتدا شور و هیجان فوری ایجاد نکرد، اما در نهایت به پایه و اساس انقلاب یادگیری عمیقی تبدیل شد که امروز شاهد آن هستیم. اکنون، پس از سالها مذاکره، کد منبع اصلی آن سرانجام برای عموم منتشر شده است.

این امر به لطف تلاش مشترک موزه تاریخ کامپیوتر و گوگل محقق شد. کد منبع، که در اصل توسط الکس کریژفسکی (Alex Krizhevsky)، دانشجوی تحصیلات تکمیلی دانشگاه تورنتو، نوشته شده بود، اکنون در GitHub بارگذاری شده است.

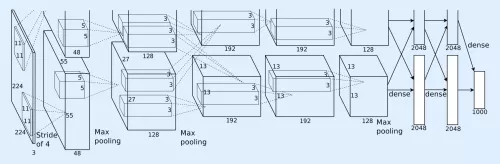

AlexNet یک شبکه عصبی بود که نقطه عطفی بزرگ در توانایی کامپیوتر برای تشخیص و طبقهبندی تصاویر محسوب میشد. تا سال ۲۰۱۲، نظریه پشت شبکههای عصبی – از جمله الگوریتم محوری پسانتشار (backpropagation) – برای دههها وجود داشت. با این حال، دو مؤلفه کلیدی گم شده بودند: مجموعه دادههای عظیم مورد نیاز برای آموزش این شبکهها و قدرت محاسباتی خام لازم برای پردازش آنها. ابتکاراتی مانند پروژه ImageNet استنفورد و برنامهنویسی GPU با CUDA انویدیا سرانجام این عناصر حیاتی را فراهم کردند.

این پیشرفتها به کریژفسکی، که تحت نظر پیشگامان هوش مصنوعی، جفری هینتون (Geoffrey Hinton) و ایلیا سوتسکور (Ilya Sutskever) کار میکرد، امکان داد تا AlexNet را آموزش دهد و پتانسیل کامل یادگیری عمیق را آشکار سازد. برای اولین بار، شبکههای عصبی عمیق، مجموعه دادههای بزرگ و محاسبات GPU با نتایج پیشگامانهای گرد هم آمدند. هر یک برای دیگری ضروری بود.

سرانجام، مقاله AlexNet در یک کنفرانس بینایی کامپیوتر در سال ۲۰۱۲ ارائه شد. در آن زمان، اکثر محققان آن را نادیده گرفتند، اما یان لکون (Yann LeCun) - که اکنون به عنوان یکی از پیشگامان برجسته هوش مصنوعی شناخته میشود - بلافاصله اهمیت آن را دریافت و آن را نقطه عطفی برای این حوزه نامید. پیشبینی او دقیق از آب درآمد. پس از رونمایی AlexNet، شبکههای عصبی به سرعت به پایه و اساس تقریباً تمام تحقیقات پیشرفته بینایی کامپیوتر تبدیل شدند.

موفقیت بزرگ AlexNet در نشان دادن این بود که آموزش یک شبکه عصبی نسبتاً ساده میتواند به عملکردی فراتر از انسان در کارهای بسیار پیچیدهای مانند تشخیص تصویر دست یابد. این، نشانگر تولد پارادایم یادگیری عمیق بود، که در آن ماشینها با دریافت و مدلسازی مجموعه دادههای عظیم، مهارتها را فرا میگیرند.

از آن لحظه، پیشرفت به سرعت شتاب گرفت. شبکههای عصبی با سرعتی بیسابقه تکامل یافتند و به نقاط عطفی مانند شکست دادن قهرمانان انسانی در بازی Go، سنتز گفتار و موسیقی واقعگرایانه و حتی تولید هنر و نوشتههای خلاقانه اصلی منجر شدند. با این حال، نقطه عطف واقعی برای هوش مصنوعی مولد (Generative AI) با انتشار ChatGPT توسط OpenAI در سال ۲۰۲۲ فرا رسید، که میتوان گفت اوج تکامل یادگیری عمیق را نشان داد.

قابل درک است که متنباز کردن چنین قطعه کد مهمی از نظر تاریخی کار سادهای نبود. موزه تاریخ کامپیوتر مجبور بود یک فرآیند مذاکره پنج ساله را با کریژفسکی، هینتون (که اکنون در گوگل است) و تیم حقوقی گوگل طی کند تا پیش از کسب تأییدیه برای انتشار فایلهای منبع اصلی، آن را به سرانجام برساند.