استبیلیتی ایآی از "دوربین مجازی پایدار" رونمایی کرد، یک سیستم هوش مصنوعی جدید که عکسهای معمولی را به ویدیوهای سه بعدی تبدیل میکند، بدون نیاز به بازسازیهای پیچیده سه بعدی یا بهینهسازی صحنه.

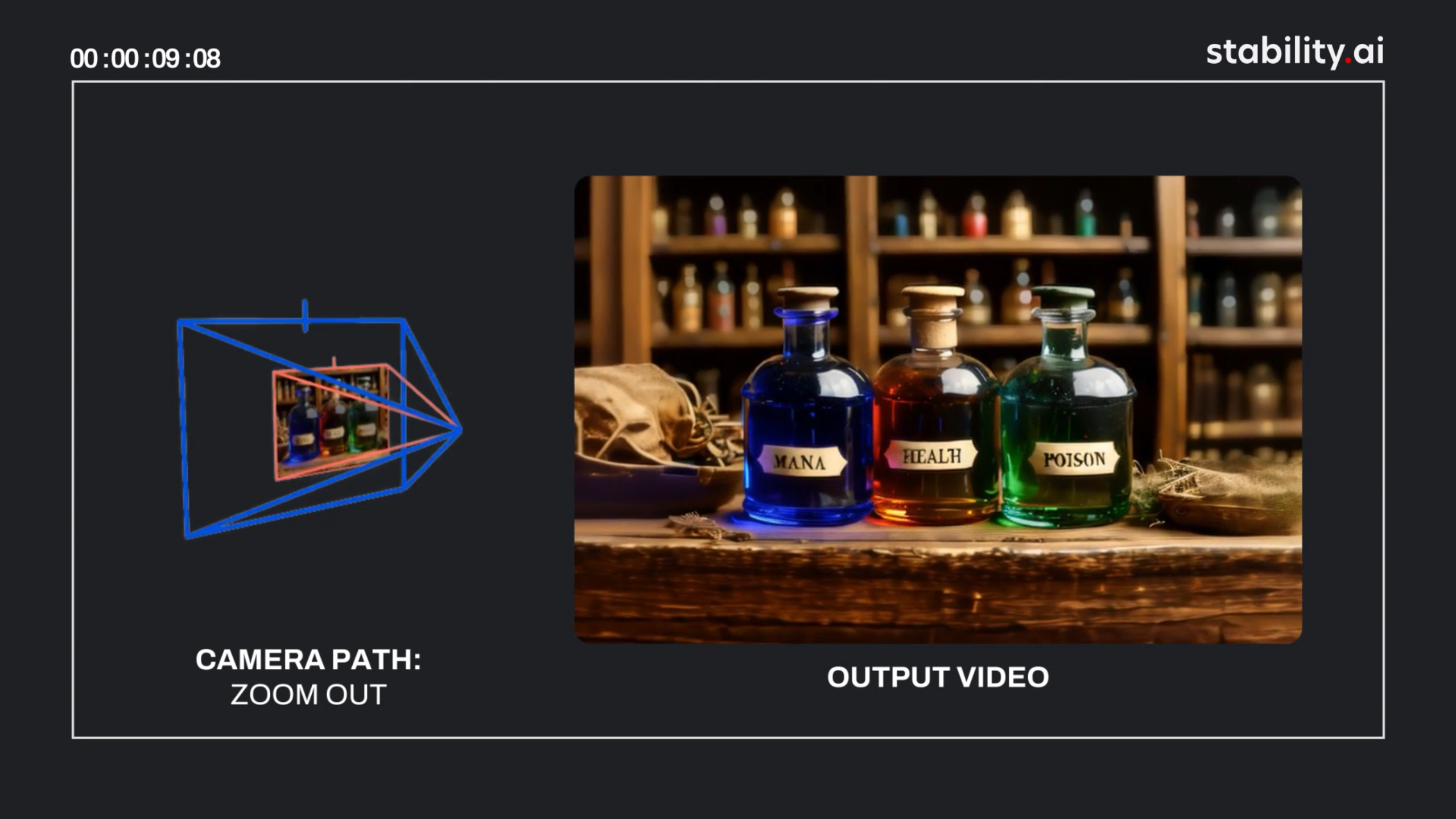

این سیستم میتواند ویدیوهای ۳۶۰ درجهای تا ۳۰ ثانیه را تنها با استفاده از یک عکس یا حداکثر ۳۲ تصویر ورودی ایجاد کند. این سیستم از ۱۴ حرکت مختلف دوربین پشتیبانی میکند، از جمله چرخشهای ۳۶۰ درجه، مارپیچها، جلوههای زوم، و الگوهای پیچیدهتر مانند لمنیسکیتها (مسیرهای حلقهای شکل). استبیلیتی ایآی میگوید هنگامی که تمام دوربینها یک مسیر را تشکیل میدهند، نماهای تولید شده سه بعدی، از نظر زمانی سازگار و - همانطور که از نامش پیداست - "پایدار" هستند.

کار با فرمتهای مختلف

این سیستم با فرمتهای مختلف تصویر از جمله مربع (۱:۱)، عمودی (۹:۱۶) و افقی (۱۶:۹) کار میکند. این قابلیت محققان را شگفتزده کرد، زیرا مدل فقط روی تصاویر مربعی ۵۷۶x۵۷۶ پیکسلی آموزش داده شده بود. تیم معتقد است که مدل به نوعی یاد گرفته است که به تنهایی اندازههای مختلف تصویر را مدیریت کند.

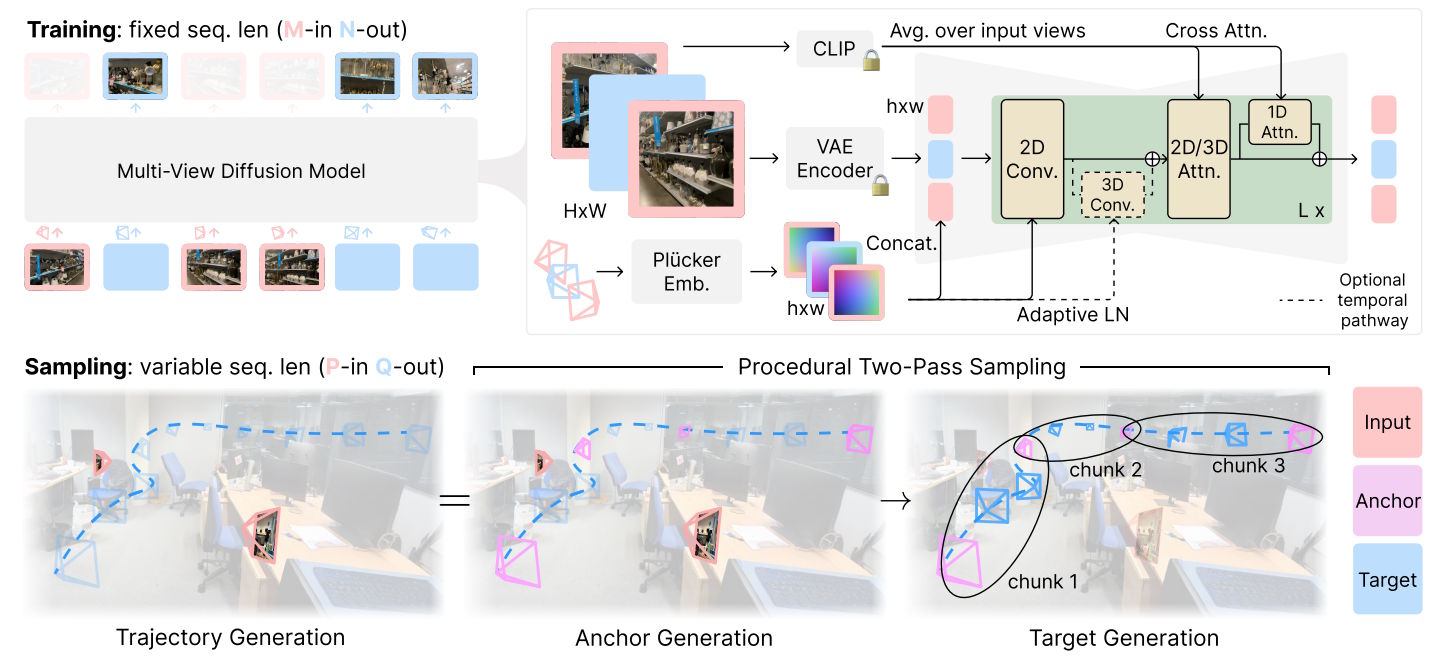

دوربین مجازی پایدار بر یک مدل انتشار با ۱.۳ میلیارد پارامتر متکی است که بر اساس معماری انتشار پایدار ۲.۱ ساخته شده است. برای بهبود درک فضایی، محققان خودآگاهی دو بعدی مدل را به خودآگاهی سه بعدی تبدیل کردند.

نتایج نشان میدهد که دوربین مجازی پایدار بهتر از راه حلهای موجود مانند ViewCrafter و CAT3D عمل میکند، به ویژه در مدیریت تغییرات پرسپکتیو بزرگ و ایجاد انتقالهای روان.

این سیستم هنوز در رندر دقیق افراد، حیوانات و عناصر پویا مانند سطوح آب مشکل دارد. مصنوعات بصری میتوانند در طول حرکات پیچیده دوربین یا هنگام پردازش صحنههای مبهم ظاهر شوند، به خصوص زمانی که پرسپکتیو مورد نظر به طور قابل توجهی با تصویر اصلی متفاوت باشد.

دسترسی

این سیستم اکنون تحت مجوز غیرتجاری در اختیار محققان قرار دارد و وزنهای مدل به صورت رایگان در Hugging Face و کد منبع در GitHub در دسترس است. یک نسخه نمایشی عمومی نیز از طریق Hugging Face قابل دسترسی است.

استبیلیتی ایآی از زمان موفقیت اولیه خود با ژنراتورهای تصویر، با رقابت فزایندهای از سوی پروژههای متنباز و رقبای تجاری روبرو بوده است، به طوری که Flux به یک جایگزین برجسته برای تولید تصویر متنباز تبدیل شده است.

این شرکت اخیراً تغییراتی داشته است تا بر دو حوزه کلیدی تمرکز کند: پیشبرد تحقیقات در پردازش سه بعدی و سنتز نمای جدید، و همچنین توسعه مدلهای بهینهسازی شده برای دستگاههای کممصرف مانند تلفنهای هوشمند.

خلاصه

- استبیلیتی ایآی یک سیستم هوش مصنوعی به نام "دوربین مجازی پایدار" ارائه میکند که ویدیوهای سه بعدی فضایی را از چند تصویر دو بعدی ایجاد میکند، بدون اینکه مجبور باشد محاسبات پیچیدهای را برای صحنههای سه بعدی پیچیده انجام دهد.

- این فناوری از یک فرآیند دو مرحلهای استفاده میکند که ابتدا فریمهای کلیدی انتخاب شده را تولید میکند و سپس دیدگاههایی را بین آنها ایجاد میکند، و از ثبات بصری و انتقالهای صاف حتی با حرکات پیچیدهتر دوربین مانند زوم، مارپیچ یا حرکات ۳۶۰ درجه اطمینان حاصل میکند.

- اگرچه این سیستم در حال حاضر از محصولات رقابتی موجود بهتر عمل میکند، اما هنوز با موضوعات چالشبرانگیز مانند افراد، حیوانات یا بافتهای متحرک مشکل دارد. مدل هوش مصنوعی به صورت رایگان برای استفاده غیرتجاری در اختیار محققان قرار دارد.

منابع: Stability AI, Arxiv