بخش تحقیقات سنتز ویدیو/تصویر به طور منظم معماریهای ویرایش ویدیو را ارائه میدهد*، و در طول نه ماه گذشته، این نوع خروجیها حتی مکررتر شدهاند. با این حال، بیشتر آنها تنها پیشرفتهای تدریجی در وضعیت هنر هستند، زیرا چالشهای اصلی اساسی هستند.

با این وجود، همکاری جدید بین چین و ژاپن در این هفته، مثالهایی را ارائه داده است که شایسته بررسی دقیقتر رویکرد هستند، حتی اگر لزوماً یک اثر برجسته نباشد.

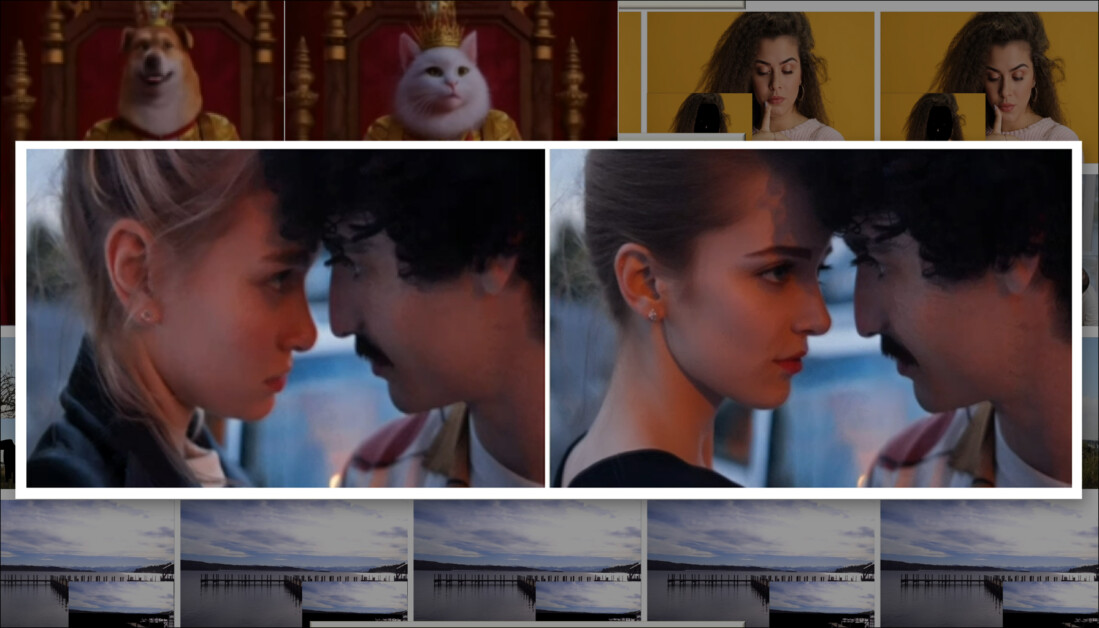

در کلیپ ویدیویی زیر (از سایت پروژه مرتبط با مقاله، که هشدار داده میشود ممکن است مرورگر شما را تحت فشار قرار دهد) میبینیم که در حالی که قابلیتهای دیپفیکینگ سیستم در پیکربندی فعلی وجود ندارد، سیستم کار خوبی را در تغییر معقول و قابل توجه هویت زن جوان در تصویر، بر اساس یک ماسک ویدیو (پایین-چپ) انجام میدهد:

برای پخش کلیک کنید. بر اساس ماسک تقسیمبندی معنایی که در پایین سمت چپ تجسم شده است، زن اصلی (بالا سمت چپ) به یک هویت قابل توجه متفاوت تبدیل میشود، حتی اگر این فرآیند به تبادل هویتی که در درخواست نشان داده شده است، دست نیابد. منبع: https://yxbian23.github.io/project/video-painter/ (آگاه باشید که در زمان نوشتن، این سایت پر از پخش خودکار و ویدیو تمایل داشت مرورگر من را خراب کند). لطفاً برای وضوح و جزئیات بهتر به ویدیوهای منبع مراجعه کنید، اگر میتوانید به آنها دسترسی داشته باشید، یا مثالها را در ویدیوی بررسی اجمالی پروژه در https://www.youtube.com/watch?v=HYzNfsD3A0s بررسی کنید.

ویرایش مبتنی بر ماسک از این نوع به خوبی در مدلهای انتشار پنهان ایستا، با استفاده از ابزارهایی مانند ControlNet به خوبی تثبیت شده است. با این حال، حفظ سازگاری پسزمینه در ویدیو بسیار چالشبرانگیزتر است، حتی زمانی که مناطق ماسکشده به مدل انعطافپذیری خلاقانه میدهند، همانطور که در زیر نشان داده شده است:

برای پخش کلیک کنید. تغییر گونه، با روش جدید VideoPainter. لطفاً برای وضوح و جزئیات بهتر به ویدیوهای منبع مراجعه کنید، اگر میتوانید به آنها دسترسی داشته باشید، یا مثالها را در ویدیوی بررسی اجمالی پروژه در https://www.youtube.com/watch?v=HYzNfsD3A0s بررسی کنید.

نویسندگان اثر جدید روش خود را هم در رابطه با معماری BrushNet خود Tencent (که سال گذشته پوشش دادیم )، و هم با ControlNet در نظر میگیرند، که هر دو به یک معماری دو شاخه میپردازند که قادر به جداسازی تولید پیشزمینه و پسزمینه است.

با این حال، اعمال مستقیم این روش به رویکرد بسیار پربار Diffusion Transformers (DiT) که توسط Sora OpenAI پیشنهاد شده است، چالشهای خاصی را به همراه دارد، همانطور که نویسندگان اشاره میکنند:

'[به طور مستقیم] اعمال [معماری BrushNet و ControlNet] به ویدیوی DiTها چالشهای متعددی را ارائه میدهد: [اولاً، با توجه به] پایه تولیدی قوی و اندازه مدل سنگین ویدیوی DiT، تکرار ستون فقرات کامل/نیمه غول پیکر ویدیوی DiT به عنوان رمزگذار زمینه غیر ضروری و از نظر محاسباتی بازدارنده خواهد بود.

'[ثانیاً، برخلاف] شاخه کنترل کانولوشن خالص BrushNet، نشانههای DiT در مناطق ماسکشده به دلیل توجه جهانی ذاتاً حاوی اطلاعات پسزمینه هستند، که تمایز بین مناطق ماسکشده و غیرماسکشده در ستون فقرات DiT را پیچیده میکند.

'[در نهایت،] ControlNet فاقد تزریق ویژگی در تمام لایهها است، که کنترل پسزمینه متراکم را برای وظایف ترمیم مانع میشود.'

بنابراین، محققان یک رویکرد plug-and-play را در قالب یک چارچوب دو شاخه با عنوان VideoPainter توسعه دادهاند.

VideoPainter یک چارچوب ترمیم ویدیوی دو شاخه ارائه میدهد که DiTهای از پیش آموزشدیده را با یک رمزگذار زمینه سبک وزن افزایش میدهد. این رمزگذار تنها 6 درصد از پارامترهای ستون فقرات را تشکیل میدهد، که به گفته نویسندگان، این رویکرد را کارآمدتر از روشهای مرسوم میکند.

این مدل سه نوآوری کلیدی را پیشنهاد میکند: یک رمزگذار زمینه سادهشده دو لایه برای راهنمایی کارآمد پسزمینه؛ یک سیستم یکپارچهسازی ویژگی انتخابی ماسک که نشانههای ماسکشده و غیرماسکشده را جدا میکند؛ و یک تکنیک نمونهبرداری مجدد شناسه منطقه ترمیم که سازگاری هویت را در طول سکانسهای ویدیویی طولانی حفظ میکند.

با مسدود کردن هم DiT از پیش آموزشدیده و هم رمزگذار زمینه در حالی که یک ID-Adapter را معرفی میکند، VideoPainter تضمین میکند که نشانههای منطقه ترمیم از کلیپهای قبلی در طول یک ویدیو باقی میمانند، و سوسو زدن و ناسازگاریها را کاهش میدهد.

این چارچوب همچنین برای سازگاری plug-and-play طراحی شده است، و به کاربران اجازه میدهد تا آن را به طور یکپارچه در جریانهای کاری موجود تولید و ویرایش ویدیو ادغام کنند.

برای پشتیبانی از این کار، که از CogVideo-5B-I2V به عنوان موتور تولیدی خود استفاده میکند، نویسندگان آنچه را که بزرگترین مجموعه داده ترمیم ویدیو تا به امروز مینامند، گردآوری کردهاند. این مجموعه با عنوان VPData ، شامل بیش از 390،000 کلیپ است، برای مدت زمان ویدیویی کل بیش از 886 ساعت. آنها همچنین یک چارچوب معیار مرتبط با عنوان VPBench توسعه دادند.

برای پخش کلیک کنید. از مثالهای وبسایت پروژه، قابلیتهای تقسیمبندی را میبینیم که توسط مجموعه VPData و مجموعه آزمون VPBench پشتیبانی میشوند. لطفاً برای وضوح و جزئیات بهتر به ویدیوهای منبع مراجعه کنید، اگر میتوانید به آنها دسترسی داشته باشید، یا مثالها را در ویدیوی بررسی اجمالی پروژه در https://www.youtube.com/watch?v=HYzNfsD3A0s بررسی کنید.

اثر جدید با عنوان VideoPainter: ترمیم ویدیو با هر طول و ویرایش با کنترل زمینه Plug-and-Play ، از هفت نویسنده در آزمایشگاه Tencent ARC، دانشگاه چینی هنگ کنگ، دانشگاه توکیو و دانشگاه ماکائو آمده است.

علاوه بر سایت پروژه ذکر شده، نویسندگان همچنین یک بررسی اجمالی YouTube در دسترستر و همچنین یک صفحه Hugging Face را منتشر کردهاند.

روش

خط لوله جمعآوری داده برای VPData شامل جمعآوری، حاشیهنویسی، تقسیمبندی، انتخاب و عنوانگذاری است:

سپس آنها 860 ساعت ویدیوی بدون حق امتیاز را از اینترنت دانلود کردند و به صورت دستی 20،000 ویدیو را با 239،000 مرجع با کیفیت بالا از یک کتابخانه با بیش از 16 میلیون شناسه برچسبگذاری کردند.

این تیم مدلهای تقسیمبندی و تشخیص اشیا را برای شناسایی مناطق نامربوط مانند برچسبها و عناصر نمایش روی صفحه آموزش دادند. این دادهها قبل از انتقال به مرحله عنوانگذاری پردازش و حذف شدند. نویسندگان اعتراف میکنند که مراحل دادههای آنها از این واقعیت که عنوانگذاری معمولاً با ویرایش ویدیو همراه نیست، جلوگیری میکند:

شمای مفهومی برای VideoPainter در زیر نشان داده شده است:

آزمایشها

نویسندگان کارایی VideoPainter را با سایر رویکردهای برتر به طور کمی و کیفی ارزیابی کردند. این روش در زمینه بازسازی و ویرایش ویدیو مورد آزمایش قرار گرفت و آزمایشهای گستردهای برای تعیین عملکرد آن در سناریوهای مختلف انجام شد.

سپس VideoPainter به طور کمی با ProPainter، COCOCO و Cog-Inp در VPBench (ماسکهای تقسیمبندی) و Davis (ماسکهای تصادفی) مقایسه شد:

در اینجا مقایسهای در برابر روشهای ترمیم در چارچوبهای قبلی وجود دارد:

این روش ارزیابی کمی برای وظایف ویرایش ویدیو را نشان میدهد. ارزیابی شامل معیارهای همسویی DISTS و CLIP است:

در نهایت، VideoPainter قادر به تبدیل یک فرد در یک ویدیو به فرد دیگری است، در حالی که پسزمینه را حفظ میکند و تراز متن را حفظ میکند:

محققان ادعا میکنند که این آزمایشها نشان میدهد که VideoPainter میتواند عملکرد و ثبات بهتری را در سناریوهای مختلف ویرایش و ترمیم ویدیو در مقایسه با رویکردهای برتر ارائه دهد. آزمایشها نشان میدهند که سیستم در حفظ کیفیت ویدیو و تراز متن موثر است و در عین حال ویرایشهای منسجمی را نیز ارائه میدهد.

یکی دیگر از نکات برجسته این کار این است که VideoPainter برای کار با طیف وسیعی از ویدیوها از منابع مختلف طراحی شده است. این انعطافپذیری در ایجاد مجموعههای داده گسترده جدید حیاتی است و به سازگاری و سودمندی در کاربردهای عملی در دنیای واقعی کمک میکند.

با این حال، یک نمایش قوی در سطح پلتفرم، و ارائه کد، به تعیین سطح پذیرش که VideoPainter دریافت خواهد کرد، کمک میکند.

نتیجه گیری

VideoPainter نمونهای امیدوارکننده از پیشرفت در زمینه ویرایش ویدیوهای هوش مصنوعی است. نویسندگان رویکردی خلاقانه برای حل برخی از چالشهای کلیدی مرتبط با ادغام مدلهای انتشار در ویرایش ویدیو ارائه دادهاند، و بر حفظ سازگاری و کیفیت در عین ارائه گزینههای ویرایشی هموار تأکید کردهاند.

به طور کلی، کار بر روی VideoPainter به این مسیر مهم از تحول در ویرایش ویدیو اشاره دارد و میتواند منجر به تکنیکهای پیچیدهتر و کاربرپسندتر شود.

* لازم به ذکر است که در هر مقاله، به دلیل محدودیت فضای متغیر در یک کتابچه راهنمای گزارش، ما هیچ استراتژی ارائهای جز استفاده از اصطلاحهای گسترده برای ایجاد طبقه وظیفه ای از این نوع نداریم. از لحاظ تئوری، همه ما میتوانیم درباره هر زمینهای به طور جداگانه بنویسیم، اما از نظر عملی، چنین چیزی برای هیچکس مفید نخواهد بود (علاوه بر نویسنده). از این گذشته، این یکی از دلایلی است که ما در اینجا به همپوشانی به عنوان چیزی فکر میکنیم که باید بهطور قابل قبولی محدود نگه داشته شود.