در طول دو سال و نیم گذشته، ویژگیای که من بیشتر از همه از مدلهای زبانی بزرگ (LLM) میخواستهام، توانایی انجام وظایف تحقیقاتی مبتنی بر جستجو از طرف من بوده است. اولین بارقههای این موضوع را در اوایل سال 2023 با Perplexity مشاهده کردیم (اولین بار در دسامبر 2022 راه اندازی شد، اولین نشت اعلان در ژانویه 2023) و سپس Microsoft Bing مجهز به GPT-4 (که در فوریه 2023 به طور چشمگیری راه اندازی/سقوط کرد). از آن زمان، افراد زیادی به این مسئله پرداختهاند، به ویژه Google Gemini و ChatGPT Search.

نسخههای سال 2023 امیدوارکننده اما بسیار ناامیدکننده بودند. آنها تمایل زیادی به توهم جزئیاتی داشتند که در نتایج جستجو وجود نداشت، به طوری که نمیتوانستید به هیچ چیزی که به شما میگفتند اعتماد کنید.

در نیمه اول سال 2025، فکر میکنم این سیستمها سرانجام از مرز مفید بودن عبور کردهاند.

تحقیقات عمیق، از سه فروشنده مختلف

ابتدا پیادهسازیهای Deep Research از راه رسیدند—Google Gemini و سپس OpenAI و سپس Perplexity محصولاتی با این نام را راهاندازی کردند و همه آنها چشمگیر بودند: آنها میتوانستند یک پرس و جو را دریافت کنند، و سپس برای چند دقیقه به جمعآوری یک گزارش طولانی با دهها (گاهی صدها) استناد بپردازند. نسخه Gemini چند هفته پیش یک ارتقاء بزرگ داشت، زمانی که آنها آن را به استفاده از Gemini 2.5 Pro تغییر دادند، و من از آن زمان نتایج برجستهای از آن دریافت کردهام.

چند دقیقه منتظر ماندن برای یک گزارش 10+ صفحهای، گردش کار ایدهآل من برای این نوع ابزار نیست. من بیتاب هستم، میخواهم پاسخها را سریعتر از آن دریافت کنم!

o3 و o4-mini در جستجو واقعاً خوب هستند

هفته گذشته، OpenAI o3 و o4-mini مجهز به جستجو را از طریق ChatGPT منتشر کرد. در ظاهر، اینها شبیه همان ایدهای هستند که قبلاً دیدهایم: مدلهای زبانی بزرگی که این گزینه را دارند که به عنوان بخشی از پاسخ دادن به یک اعلان، یک ابزار جستجو را فراخوانی کنند.

اما یک تفاوت بسیار مهم وجود دارد: این مدلها میتوانند جستجوها را به عنوان بخشی از فرآیند استدلال زنجیرهای تفکر که قبل از ارائه پاسخ نهایی خود استفاده میکنند، اجرا کنند.

این موضوع به یک مسئله بزرگ تبدیل میشود. من انواع سؤالات را به ChatGPT (در حالت o3 یا o4-mini) پرتاب کردهام و پاسخهای واقعاً مفیدی را دریافت کردهام که مبتنی بر نتایج جستجو هستند. من هنوز هیچ توهمی را مشاهده نکردهام، و برخلاف سیستمهای قبلی، به ندرت پیش میآید که وقتی میبینم چه کاری انجام میدهند، سرشان فریاد بزنم "نه، برای آن جستجو نکن!".

در اینجا چهار نمونه رونوشت اخیر آورده شده است:

- مشخصات از جمله VRAM برای RTX 5090 و RTX PRO 6000 را به من بدهید—به علاوه تاریخ انتشار و قیمت

- یک ابزار وبسایت برای من پیدا کنید که به من اجازه میدهد یک URL را در آن جایگذاری کنم و تعداد کلمات و زمان تخمینی مطالعه را به من میدهد

- مشخص کنید که ChatGPT از چه موتور جستجویی برای o3 و o4-mini استفاده میکند

- قیمت Cloudflare r2 را جستجو کنید و از پایتون برای فهمیدن اینکه این (تصویر داشبورد) چقدر هزینه دارد استفاده کنید

صحبت کردن با o3 مانند صحبت کردن با یک ابزار Deep Research در زمان واقعی است، بدون اینکه مجبور باشید چند دقیقه منتظر بمانید تا یک گزارش بیش از حد طولانی تولید کند.

حدس من این است که انجام این کار به خوبی نیاز به یک مدل استدلال بسیار قوی دارد. ارزیابی نتایج جستجو به دلیل نیاز به عبور از مقادیر زیادی هرزنامه و اطلاعات فریبنده دشوار است. نتایج ناامیدکننده از پیادهسازیهای قبلی معمولاً به این دلیل بود که وب پر از آشغال است.

شاید o3، o4-mini و Gemini 2.5 Pro اولین مدلهایی هستند که از آستانه مقاومت در برابر زودباوری عبور کردهاند تا جایی که میتوانند این کار را به طور موثر انجام دهند؟

گوگل و آنتروپیک باید به پای آنها برسند

برنامه Google Gemini که در دسترس کاربران است نیز میتواند جستجو کند، اما به من نشان نمیدهد که برای چه چیزی جستجو میکند. در نتیجه، من فقط به آن اعتماد نمیکنم. این یک فرصت از دست رفته بزرگ است، زیرا گوگل احتمالاً بهترین فهرست جستجو را دارد، بنابراین واقعاً باید بتواند نسخه عالی از این را بسازد. و جستجوی مبتنی بر هوش مصنوعی گوگل در رابط جستجوی معمولی آنها به شدت توهم میزند تا جایی که به طور فعال به برند آنها آسیب میزند. من همین الان بررسی کردم و گوگل هنوز هم برای Encanto 2 آشغال نشان میدهد!

Claude نیز سرانجام یک ماه پیش جستجوی وب را اضافه کرد، اما به این خوبی نیست. این از فهرست جستجوی Brave استفاده میکند که فکر نمیکنم به اندازه Bing یا Gemini جامع باشد، و جستجوها به عنوان بخشی از آن جریان استدلال قدرتمند اتفاق نمیافتند.

انتقال تنبل کد به یک نسخه کتابخانه جدید از طریق جستجو

لحظه واقعاً جادویی برای من چند روز پیش رخ داد.

ابزار تقسیمبندی تصویر Gemini من از کتابخانه @google/generative-ai استفاده میکرد که به طور آشکار منسوخ شده است به نفع کتابخانه Google Gen AI SDK @google/genai که هنوز در حال پیش نمایش است.

من تمایلی به انجام کار ارتقاء نداشتم. از روی هوس، کد کامل HTML خود (با جاوا اسکریپت درون خطی) را در ChatGPT o4-mini-high جایگذاری کردم و این اعلان را دادم:

این کد باید به کتابخانه جاوا اسکریپت توصیه شده جدید از گوگل ارتقاء یابد. مشخص کنید که آن چیست و سپس به اندازه کافی مستندات جستجو کنید تا این کد را به آن منتقل کنید.

(من حتی زحمت جستجوی نام کتابخانه جدید را هم نکشیدم!)

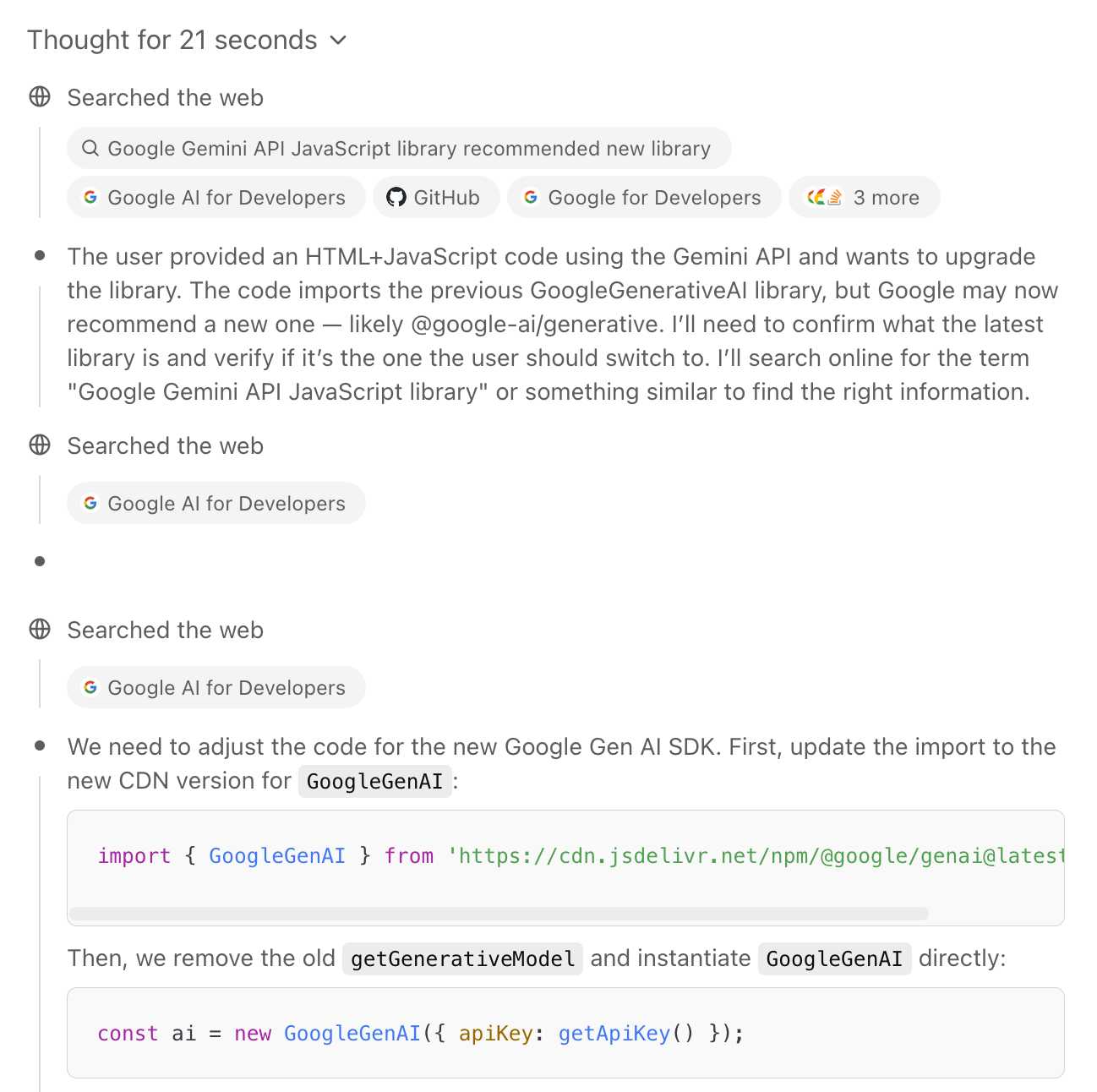

... این دقیقاً همان کار را انجام داد. 21 ثانیه فکر کرد، تعدادی جستجو انجام داد، کتابخانه جدید را فهمید (که خیلی دور از تاریخ قطع آموزش آن وجود داشت)، دستورالعملهای ارتقاء را پیدا کرد و یک نسخه جدید از کد من را تولید کرد که کاملاً کار میکرد.

من این اعلان را روی تلفن خود از روی کنجکاوی بیکار در حالی که مشغول انجام کار دیگری بودم، اجرا کردم. من بسیار تحت تأثیر قرار گرفتم و شگفتزده شدم وقتی دقیقاً همان کاری را انجام داد که نیاز داشتم.

مدل اقتصادی وب چگونه کار میکند؟

من امروز در مورد این موضوع مینویسم زیرا این یکی از سؤالات "آیا مدلهای زبانی بزرگ (LLM) میتوانند این کار را به طور قابل اعتماد انجام دهند؟" من در طول دو سال گذشته بوده است. فکر میکنم آنها به تازگی از مرز مفید بودن به عنوان دستیار تحقیق عبور کردهاند، بدون اینکه احساس نیاز به بررسی همه چیز که میگویند با یک شانه دندانهریز داشته باشم.

من هنوز به آنها اعتماد ندارم که اشتباه نکنند، اما فکر میکنم ممکن است به اندازه کافی به آنها اعتماد کنم که بررسی حقایق خود را برای کارهای کماهمیتتر نادیده بگیرم.

این همچنین به این معنی است که تعدادی از آیندههای تاریک بالقوه که ما در چند سال گذشته پیشبینی کردهایم، احتمالاً به واقعیت تبدیل میشوند. چرا از وبسایتها بازدید کنیم اگر میتوانیم پاسخهای خود را مستقیماً از ربات چت دریافت کنیم؟

دادخواستها بر سر این موضوع از زمانی شروع شد که مدلهای زبانی بزرگ (LLM) هنوز عمدتاً آشغال بودند. اکنون که آنها در واقع در آن خوب هستند، خطرات بسیار بیشتر است!

من میتوانم احساس کنم که استفاده من از جستجوی گوگل از قبل در حال کاهش است. من انتظار یک سواری ناهموار را دارم زیرا یک مدل اقتصادی جدید برای وب در حال ظهور است.